数据治理之基石 基础软件服务如何赋能数据质量管理

在数据驱动的时代,数据质量已成为企业数字化转型和智能决策的生命线。数据治理作为保障数据资产价值的系统性工程,其核心目标之一便是提升数据质量。而这一目标的实现,离不开底层基础软件服务的强力支撑。本文将探讨基础软件服务如何作为数据治理的关键基础设施,为数据质量管理奠定坚实基石。

一、数据质量管理的核心挑战

数据质量涉及准确性、完整性、一致性、时效性和唯一性等多个维度。企业在实践中常面临数据源分散、格式不一、标准缺失、流程断点等挑战,导致“脏数据”、“重复数据”和“数据孤岛”现象频发,严重影响业务洞察与运营效率。传统的点对点数据清洗或人工干预不仅成本高昂,且难以规模化、持续化。

二、基础软件服务:数据质量管理的技术底座

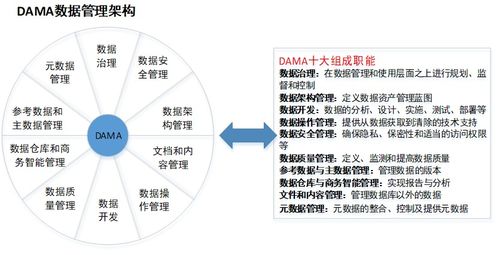

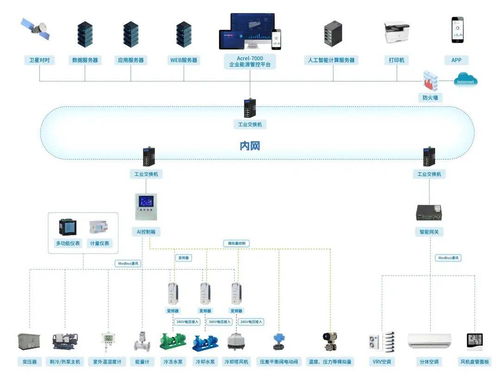

基础软件服务,包括数据集成平台、元数据管理工具、主数据管理(MDM)系统、数据质量监控引擎及数据目录等,共同构成了数据质量管理的技术底座。它们从不同层面为数据质量的提升提供系统性解决方案:

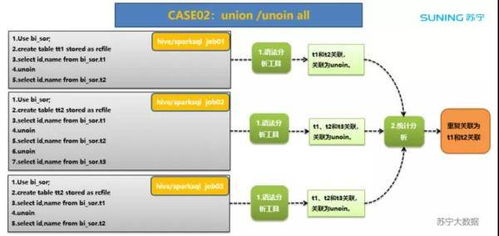

- 数据集成与ETL/ELT服务:这是数据质量管理的“第一道防线”。通过规范化的数据抽取、转换和加载流程,基础软件能够对来自异构源系统的数据进行初步清洗、格式标准化和关键字段校验,确保进入数据仓库或数据湖的数据具有基本的一致性。现代云原生数据集成平台更支持实时数据流处理,提升了数据的时效性。

- 元数据管理与数据目录:元数据是“关于数据的数据”,描述了数据的来源、含义、关系与流转过程。强大的元数据管理服务能够自动采集技术元数据、业务元数据与操作元数据,并通过数据目录以可搜索、可理解的方式呈现。这帮助用户快速理解数据上下文,识别数据血缘关系,从而在数据问题出现时能够快速追溯根源,评估影响范围,是保障数据可信度与一致性的关键。

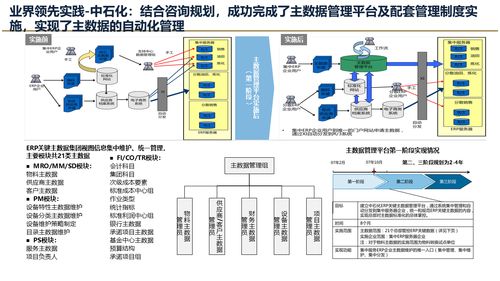

- 主数据管理(MDM):对于客户、产品、供应商等核心业务实体,MDM系统通过创建并维护单一、准确、权威的“黄金记录”,从源头上解决了数据不一致和重复的问题。它定义了统一的数据模型、标识符和治理规则,确保跨系统、跨部门的核心数据同源、同构,是提升数据准确性与完整性的核心工具。

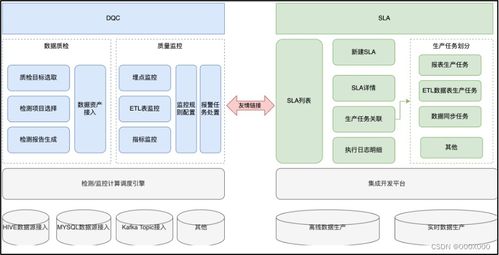

- 数据质量监控与剖析引擎:这是数据质量管理中“持续监控”环节的核心。这类基础软件允许用户定义丰富的质量规则(如完整性检查、格式校验、值域范围、跨表一致性规则等),并自动化、计划性地对数据进行扫描、评估和评分。一旦发现异常,能够立即触发告警,并生成详细的质量报告,驱动数据问题的闭环修复。

- 数据治理平台(集成化):越来越多的厂商提供集成了上述能力的一体化数据治理平台。这种平台以工作流引擎为核心,将数据质量规则的定义、执行、监控、问题分派、整改跟踪等流程线上化、标准化,使得数据质量管理不再是IT部门的独角戏,而是业务与IT协同参与的常态化运营工作。

三、构建以基础软件为支撑的数据质量体系

要发挥基础软件服务的最大效能,企业需要构建一个体系化的数据质量管理框架:

- 策略与标准先行:在部署工具前,明确数据质量的目标、衡量指标(DQM KPI)以及各数据域的质量标准。

- 工具选型与整合:根据企业数据架构和技术栈,选择能够无缝集成、满足场景需求的基础软件服务组合。云服务的灵活性使其成为主流选择。

- 流程嵌入与自动化:将数据质量检查点嵌入到数据生产、加工和消费的全链路中,尽可能实现质量控制的自动化,减少人工依赖。

- 组织与文化保障:建立明确的数据质量责任制(如数据所有者),并利用工具提供的透明化报告和协作功能,培育全员关注数据质量的文化。

没有高质量的数据,高级的数据分析与人工智能应用就如同建立在流沙之上。基础软件服务通过提供自动化、规模化、智能化的技术能力,使企业能够系统性地度量和提升数据质量,从而释放数据资产的真实价值。在数据治理的征途上,投资于坚实、灵活的基础软件服务,就是投资于企业未来的决策智能与核心竞争力。

如若转载,请注明出处:http://www.quboluo.com/product/63.html

更新时间:2026-02-24 20:53:07